Що таке ШІ-згенерований контент?

Контент, згенерований штучним інтелектом (далі — ШІ), — це текст, аудіо або відео, яке створюється алгоритмами та системами ШІ автономно та без втручання користувача в цей процес. Слід розрізняти такий контент та контент, створений за допомогою ШІ, але зі значним внеском користувача. Різниця між цими видами контенту полягає у наступному:

- ШІ-згенерований контент: контент, створений автономною системою за запитом користувача (наприклад, «1 the Road» Роса Гудвіна, тексти від ChatGPT, новинний канал «Channel 1», картинки від Midjourney, відео від SORA.AI, музика від AIVA тощо);

- ШІ-модифікований контент: контент, створений людиною із використанням інструментів на основі ШІ для редагування, уточнення, перевірки помилок або іншого поліпшення цього контенту (наприклад, написання текстів за допомогою Grammarly, переклад текстів у Deepl, інтерактивна дошка в Jeda.ai, обробка фото у Photoshop, обробка відео в Usevoice.io тощо).

Отже, картинка, згенерована Midjourney — це ШІ-згенерований контент, а особисте фото користувача, оброблене ним у програмі Photoshop, — ні. Станом на 2024 рік 85,1% користувачів ШІ використовують технологію для написання статей і створення контенту. ШІ-згенерований контент застосовується в широкому спектрі галузей: від медіа, маркетингу, розваг до освіти та технічного обслуговування сайтів, програм та застосунків. Такі системи вже використовуються для створення статей, новин, музики, чат-ботів та відео-ігор. Поширене застосування ШІ-згенерованого контенту й у соціальних мережах. WhatsApp щодня генерує понад 100 мільярдів повідомлень, оброблених ШІ, а Amazon та Hopper використовують ШІ-згенерований контент у персоналізованих рекомендаціях користувачам та рекламі в соціальних мережах. Аналогічно Heinz і Nestlé вже використовували контент, згенерований ШІ, у рекламних кампаніях. Стрімка популяризація використання таких матеріалів призводить до появи не тільки значних переваг, а й багатьох ризиків, із якими законодавці та пересічні читачі не завжди встигають впоратись.

Чим небезпечний ШІ-згенерований контент?

Не все те золото, що блищить. У світлі нещодавнього буму популярності фільму «Вонка» з Тімоті Шаламе, у Глазго 24 лютого відкрили тематичну виставку «Шоколадний досвід Віллі», присвячену фільму. Використання яскравих ШІ-згенерованих зображень в рекламі привернуло увагу багатьох відвідувачів, яким обіцяли «повне занурення в атмосферу й день чистої уяви та дива». Але попри магічну промоцію заходу, батьки й діти отримали відверто гіркий досвід, коли зрозуміли, що виставка не має нічого спільного з рекламою, яку вони бачили. Ось для порівняння два зображення: зліва картинка, яку використовували в рекламі організатори заходу, а справа — реальне фото з самого заходу.

Фото: The Guardian

Масові виклики поліції та заяви з вимогами повернути гроші за відвідування переросли у масштабний скандал, який став одним з десятків і сотень прикладів оманливого, небезпечного або шкідливого використання ШІ-згенерованого контенту. Попри зростаючу популярність генеративного ШІ, використання такого контенту несе значні загрози:

- Ризики, пов’язані з авторським правом. Для створення ШІ-згенерованого контенту платформи на кшталт ChatGPT навчаються на вже існуючих даних, що може спричинити порушення авторських прав багатьох творців та користувачів в інтернеті як при навчанні таких платформ, так і при генеруванні контенту цими системами. Ця проблема вже стала причиною багатьох судових спорів, наприклад, Raw Story Media, Inc. v OpenAI Inc, Getty Images v StabilityAI, Basbanes v Microsoft Corp. and OpenAI тощо.

- Ризики для творчого сектору. Крім питань, пов’язаних із плагіатом, ШІ-згенерований контент несе в собі й інші ризики для креативних професій. Оскільки ШІ надає багато можливостей для спрощеного створення контенту звичайними користувачами, потреба в ексклюзивних навичках митців, дизайнерів, авторів та інших професій відчутно падає. Інструменти на кшталт SORA.AI, що дозволяють перетворити текст на реалістичне відео за лічені секунди, відкривають неймовірні можливості для користувачів та незабаром можуть стати повноцінним замінником для більшості професій, пов’язаних зі створенням відеоконтенту. Дослідження Goldman Sachs свідчить, що генеративний ШІ має потенціал для автоматизації 26% робочих завдань у сферах мистецтва, дизайну, розваг та медіа.

- Ризики, повʼязані з дезінформацією. Оскільки кількість ШІ-згенерованого контенту в соціальних мережах стрімко зростає щодня, зростає і його вплив на соціум. 85,1% користувачів використовують такий контент у своїх блогах. Створені ШІ пости на політичні теми можуть впливати на результати виборів, а ще більшу загрозу несе технологія Deepfake, що дозволяє реалістично імітувати зовнішність та голос. Наприклад, незадовго до праймеріз у штаті Нью-Гемпшир у 2024 році ШІ-згенерований голос імітував голос президента Байдена і закликав виборців не брати участь у цих виборах. Всі ми також пам’ятаємо невдалу спробу росіян створити Deepfake-відео з Володимиром Зеленським, який нібито анонсував капітуляцію України. Схожий випадок трапився у Словаччині, коли за декілька днів до виборів мережею поширився Deepfake-аудіозапис одного з кандидатів, на якому той нібито вихвалявся своїми фальсифікаціями на виборах.

- Ризики порушення приватності. Окрім потужних засобів дезінформації, ця технологія також відкриває двері для порушення приватності й так званої «крадіжки особистості» (від англ. «identity fraud»). Сталою практикою стає використання зовнішності популярних осіб для створення різного контенту без їхньої згоди. Так, наприклад, шахраї вкрали особистість української блогерки Ольги Лоєк та створили її віртуальних клонів для реклами російських товарів у Китаї, а також для просування тісних зв’язків росії та Китаю. Найімовірніше, що ці відео розробили з використанням технологій компанії HeyGen, які у жовтні 2023 року були використані для створення реалістичних відео з Дональдом Трампом та Тейлор Свіфт, у яких вони розмовляють китайською мовою. У січні співачка також потерпала від масового розповсюдження ШІ-згенерованих оголених фото з її обличчям на платформі X. У жовтні того ж року пролунав схожий скандал, а саме скам з використанням обличчя популярного американського Youtube блогера Mr.Beast. На відео аватар з його обличчям нібито роздавав 10 000 телефонів IPhone 15 Pro, а насправді шахрайське відео спрямовувало користувачів на фальшивий сайт, що крав особисту інформацію та гроші.

- Ризики дискримінації. Важливо пам’ятати і про ризик створення ШІ-системою дискримінаційного контенту через упередженість даних, на яких тренується система. Моделі з генерування зображень Stable Diffusion та DALL-E 3 ще з листопада 2023 року критикуються за вплив культурних, расових та гендерних стереотипів на зображення, які вони генерують. Наприклад, красивими та успішними людьми ці моделі переважно вбачають білих чоловіків, а на прохання показати злочинців переважно генерують зображення афроамериканців. Водночас, спроби компенсувати можливу упередженість даних, на яких тренуються системи, поки також не є успішними. Приклад — нещодавні скарги від користувачів Gemini про те, що сервіс генерує расово нечутливі зображення, такі як зображення німецьких нацистських солдатів як афроамериканців та азіатів або батьків-засновників США як афроамериканців. Google вирішили тимчасово призупинити роботу Gemini, поки ця проблема не буде вирішена.

Попри те, що кожен випадок використання ШІ-згенерованого контенту є унікальним, експерти вирізняють ряд універсальних практик, необхідних для безпечного використання цих технологій. Однією з них є маркування генерованого контенту, що дозволяє аудиторії цього контенту завжди знати про те, що він ШІ-згенерований. Маркування забезпечує зменшення кількості порушень авторських прав, покращує вирізнення контенту у творчому секторі та, що найголовніше, забезпечує користувачів інтернету захистом від фейків та дезінформації, спричиненої ШІ-згенерованим контентом.

Маркування контенту на міжнародному та регіональному рівні

Станом на сьогодні, у світі вже відбувається багато процесів, направлених на те, аби зробити використання ШІ-згенерованого контенту безпечним та зручним для користувачів. Багато країн та регіональних інституцій активно працюють над створенням ефективних правових норм щодо ШІ. Окрім цього, багато компаній також працюють над розробкою внутрішніх правил та застосуванням безпечних практик маркування ШІ-згенерованого контенту.

Міжнародні ініціативи

Однією з найбільш впливових ініціатив у регулюванні ШІ-згенерованого контенту та технологій ШІ в цілому є Акт про штучний інтелект, прийняття якого незабаром очікується на рівні ЄС. Відповідно до його положень, генеративний ШІ на кшталт ChatGPT повинен відповідати вимогам прозорості, що передбачає:

- розкриття інформації про контент, що був згенерований ШІ;

- розробку моделі таким чином, щоб вона не генерувала нелегальний контент;

- публікацію аналізу та підсумків щодо захищених авторським правом даних, які використовуються для навчання.

Окрім цього, стаття 52 останньої версії Акта вимагає, щоб системи ШІ, призначені для безпосередньої взаємодії з фізичними особами, були спроєктовані та розроблені таким чином, аби особи були проінформовані про взаємодію із системою ШІ. Винятком є випадки, коли це є очевидним для людини, враховуючи обставини та контекст використання систем. Отже, розробники систем ШІ, що генерують синтетичний аудіо-, відео- або текстовий контент, повинні забезпечити маркування вихідних даних цих систем у машинозчитуваному форматі, аби їх можна було розпізнати як ШІ-генеровані або ШІ-модифіковані.

На практиці розробники мають не тільки ввести маркування контенту, а й технічно забезпечити його з урахуванням специфіки різних типів контенту. По суті, Акт передбачає введення маркування як стандартної практики із загальною метою у вигляді чіткого розмежування ШІ-згенерованого та звичайного контенту для користувачів. Він також передбачає відповідальність за недотримання цих правил у вигляді значних штрафів (можуть сягати 35 мільйонів євро або 7% річного обороту компанії). Акт матиме широке охоплення та буде застосовуватися до використання систем ШІ будь-якою організацією або урядом в ЄС незалежно від того, де ці системи розробляються. Отже, навіть компанії за межами ЄС повинні будуть дотримуватися правил цього Акта, якщо вони хочуть працювати в Європі.

Окрім цього Акта, світові лідери працюють над впровадженням рекомендацій, які полегшують процес маркування ШІ-згенерованого контенту. 30 жовтня 2023 року Європейська комісія привітала угоду лідерів G7 щодо «Міжнародних керівних принципів зі штучного інтелекту» та добровільного «Кодексу поведінки для розробників ШІ» в рамках Хіросімського процесу із ШІ. Ці принципи та Кодекс поведінки також встановлюють необхідність маркування ШІ-згенерованого контенту. Обидва документи також беруть за основу «Принципи ШІ Організації економічного співробітництва та розвитку», які поки не описують конкретно процедуру маркування, проте встановлюють загальне правило прозорості, що лежить в її основі.

Рада Європи також розробляє власні рекомендації щодо ШІ та верховенства права. Так, Комітет зі штучного інтелекту прийняв «Проєкт Рамкової Конвенції про штучний інтелект, права людини, демократію та верховенство права», який у своїй 7 статті встановлює, що державам слід вживати заходів для прозорості систем ШІ протягом усього циклу їх існування, що також передбачає виявлення та ідентифікацію ШІ-згенерованого контенту.

ЮНЕСКО працює у багатьох напрямках, аби запровадити етичну та безпечну розробку й використання систем ШІ та ШІ-згенерованого контенту. Ще у 2021 році 193 країни підтримали «Рекомендації з етики штучного інтелекту», які закріплюють принципи прозорості та підтримують загальне правило про те, що користувачі мають знати, що взаємодіють із ШІ-згенерованим контентом. Також нещодавно відбувся Глобальний форум ЮНЕСКО з етики штучного інтелекту, що став наступним кроком у розвитку відповідального управління ШІ. Цей форум, зокрема, запустив Глобальну обсерваторію етики та управління ШІ — новаторську платформу, призначену для сприяння знанням, експертним думкам і передовим практикам у сфері етики та управління ШІ.

Іноземні практики

Окрім міжнародних та регіональних ініціатив, багато країн починають вводити на національному рівні правила щодо маркування ШІ-згенерованого контенту. В Китаї ще в серпні минулого року були прийняті Закон про генеративний ШІ та «Стандарти маркування», що зобовʼязують маркувати ШІ-згенерований контент. Важливо, що на відміну від більшості інших актів, Стандарти маркування не просто надають загальні рекомендації, а й слугують детальним технічним посібником з чіткими інструкціями про те, яким має бути маркування. Так, наприклад, ці стандарти пропонують два можливих варіантів позначення:

- Видимий водяний знак: напівпрозорий текст, доданий у фоновому режимі на зображення або відео. Розробник може налаштувати параметри відображення так, щоб видимий водяний знак міг не впливати на звичайне використання контенту, але все ще бути чітко помітним, наприклад, якщо його прозорість становить 90%.

- Невидимий водяний знак: маркування, що додається шляхом модифікації зображення, аудіо- чи відеоконтенту, який не може бути безпосередньо сприйнятий людиною, але може бути виявлений з контенту технічними засобами.

Окрім методів маркування, китайські Стандарти вказують і чіткі вимоги до самого позначення. Так, у зоні відображення ШІ-згенерованого контенту повинен бути доданий рівномірно видимий водяний знак із текстом на кшталт «Згенеровано ШІ». ШІ-згенеровані зображення та відео позначаються текстом у кутах екрана площею не менше 0,3% екрана або з висотою тексту не менше 20 пікселів. До створеного контенту також додається невидимий водяний знак, що містить назву постачальника послуг, а також унікальний номерний ідентифікатор контенту або іншу релевантну інформацію. Отже, ці стандарти надають конкретні й чіткі інструкції, що допомагає компаніям та користувачам застосовувати маркування ШІ-згенерованого контенту.

Попри те, що переважна більшість країн ще не встигла прийняти та затвердити чіткі правила щодо маркування ШІ-згенерованого контенту, у багатьох країнах вже розпочато цей процес і ми сподіваємось скоро побачити його результати. Наприклад, у США на розгляді Сенату зараз «Акт про маркування ШІ 2023», який вимагатиме маркування в обов’язковому порядку, аналогічно до ЄС та Китаю. Також президент Джо Байден видав Указ «Про безпечний, захищений та надійний розвиток і використання штучного інтелекту», у якому впроваджує необхідність та засоби маркування ШІ-згенерованого контенту. Так, цей указ змушує відповідні органи визначити існуючі стандарти та інструменти для:

- автентифікації контенту та відстеження його походження;

- маркування синтетичного контенту, наприклад, за допомогою водяних знаків;

- виявлення синтетичного контенту тощо.

Указ також встановлює обов’язок ряду державних установ США видати інструкції для агенцій щодо маркування та перевірки автентичності ШІ-згенерованого контенту, який вони виробляють або публікують. У цих інструкціях вони мають встановити стандарти для нанесення водяних знаків або іншого маркування ШІ-згенерованого контенту. Окрім федеральних ініціатив, окремі прецеденти із застосуванням маркування стаються й на рівні окремих штатів. Зокрема, у Вісконсині прийняли двопартійний Акт, який вимагає від усіх передвиборчих кампаній повідомляти, коли в політичній рекламі використовуються ШІ-згенерований контент, та вводить штраф 1000 доларів США за порушення цього правила. Схожі законопроєкти прийняли штати Каліфорнія, Мічиган, Міннесота, Техас і Вашингтон. Також у Флориді розпочали процес із прийняття такого законопроєкту на фоні скандалу з використанням ШІ-згенерованих зображень Дональда Трампа губернатором Флориди Роном ДеСантісом.

У Сполученому Королівстві регуляція питань ШІ-згенерованого контенту також включає в себе поступову розробку їхнього «Закону про безпеку в Інтернеті», який прямо вказує про необхідність позначати ШІ-згенерований контент та всіляко запобігати омані користувачів систем ШІ. Законопроєкт знаходиться на завершальній стадії прийняття парламентом, перш ніж він має отримати королівський дозвіл. Окрім встановлення обов’язків маркування, Закон також вводить штрафи для компаній до 10% їхнього глобального доходу за порушення його положень. Парламент Сполученого Королівства також випустив аналітику про «Політичні наслідки штучного інтелекту», які визначають проблеми ШІ-згенерованого контенту та підкреслюють необхідність маркування як одного з методів вирішення цих проблем.

А в Австралії розробляється національне законодавство, яке пропонуватиме добровільне запровадження маркування на розсуд компаній. Це законодавство візьме за основу «Австралійські принципи етики ШІ», серед яких закріплюються принципи прозорості та відповідальності. Це, у свою чергу, передбачає інформування користувачів про природу ШІ-згенерованого контенту, коли вони з ним взаємодіють, а також встановлення чіткої відповідальності розробників систем ШІ за результати роботи цих систем та постійний нагляд за ними. Також Національна рада з науки і технологій Австралії випустила «Інформаційний звіт швидкого реагування: генеративний ШІ» про стратегії, які варто запровадити для регулювання впливу ШІ, де в тому числі відзначається необхідність прозорості та поінформованості користувачів про взаємодію з ШІ-згенерованим контентом та системами ШІ.

В Японії розробляється «Керівництво із штучного інтелекту для бізнесу», яке пропонує компаніям підвищити зрозумілість та прозорість своїх систем ШІ, у тому числі завдяки впровадженню маркування у вигляді видимих водяних знаків на ШІ-згенерованому контенті. Кінцевою метою розробників має бути досягнення рівня прозорості, за якого користувачі систем ШІ завжди чітко розуміють, що контент ШІ-згенерований. Керівництво також закликає компанії та законотворців чітко визначати відповідальність за порушення вимог маркування контенту.

В Індії 1 березня ввели «Рекомендації щодо затвердження та маркування інструментів ШІ» які встановлюють чіткі правила, що будь-який Інтернет-посередник, що використовує ШІ-згенерований контент, що може спричинити дезінформацію, повинен відповідно позначати такий контент. Рекомендації також вказують на необхідність маркувати такий контент спеціальним ідентифікатором або через метадані, які б вказували на систему ШІ, якою було згенеровано контент.

В Україні нещодавно Міністерство цифрової трансформації випустило «Рекомендації з відповідального використання штучного інтелекту у сфері медіа», в яких також визначається необхідність маркування ШІ-згенерованого контенту. Мета цих рекомендацій — запровадження принципів відповідальної розробки та використання систем ШІ, зокрема принципи прозорості, поінформованості користувачів та відповідальності. Ці рекомендації також дають детальну інструкцію про те, як обрати систему ШІ для роботи та як оцінити ШІ-згенерований контент на відповідність усім встановленим принципам, що включає в себе вимогу маркування такого контенту. Також за підтримки Національної асоціації адвокатів України створено Робочу групу з питань правового регулювання штучного інтелекту, що займається аналізом найважливіших юридичних питань розробки та використання ШІ. Окремо варто зазначити, що в Україні анонсували запуск «регуляторної пісочниці» для ШІ-розробок. Це проєкт, направлений на добровільну експертну підтримку розробників систем ШІ, аби вони мали більше успіху у виході на ринок ЄС. Кінцева мета цієї ініціативи полягає у підготовці українських регуляцій щодо ШІ та самих компаній розробників до запровадження Акта про ШІ в ЄС, що включатиме і вимоги щодо маркування ШІ-згенерованого контенту.

Приватні ініціативи

Розробники технологій ШІ. Окрім багатьох ініціатив урядів та міжнародних організацій, різні компанії, соціальні мережі та медіа роблять значний внесок у те, аби запровадити маркування ШІ-згенерованого контенту. Так, Google оголосила, що приєднається до керівного комітету Коаліції з перевірки походження та автентичності контенту (C2PA) — ключової групи, яка встановлює стандарти для різних типів контенту із ШІ. Google також почне підтримувати маркування у вигляді Content Credentials — своєрідної «харчової марки» для ШІ-згенерованого контенту, створену C2PA та Content Authenticity Initiative (CAI). У листопаді 2023 року Google оновила свою «Політику щодо політичного контенту» і зробила обов’язковим для всіх рекламодавців, які хочуть показувати передвиборчу рекламу, вказувати, що їхня реклама містить ШІ-згенерований контент, якщо це так.

OpenAI також анонсувала, що планує імплементувати C2PA стандарт — відкритий технічний стандарт, який дозволяє видавцям та компаніям вбудовувати метадані в медіа для перевірки їхнього походження та супутньої інформації. Ряд компаній, а саме Anthropic, Alphabet, Amazon, Inflection, Microsoft та OpenAI, взяли на себе добровільні зобовʼязання перед Білим домом запровадити маркування ШІ-згенерованого контенту, а також ретельно тестувати системи перед їх випуском і ділитися інформацією про те, як зменшити ризики та інвестувати в кібербезпеку. Окрім цього, 16 лютого Google, Microsoft, Meta, OpenAI, Adobe і TikTok підписали угоду, аби виявляти і маркувати створений ШІ контент під час виборів. Ця ініціатива направлена на запобігання маніпуляціям під час президентських виборів у США та інших країнах по всьому світу.

Соціальні мережі. Крім угоди між рядом компаній, багато соціальних мереж запроваджують власні правила щодо маркування ШІ-згенерованого контенту. Аналогічно до OpenAI, Meta працює над імплементацією C2PA стандарту для всіх своїх платформ, що має забезпечити більш успішне та детальне маркування й виявлення ШІ-згенерованого контенту. Хто ж очолює список лідерів з маркування?

- X (Twitter) має оновлену «Політику щодо синтетичних та маніпульованих даних», яка хоч і не виділяє окремо ШІ-згенерований контент, але забороняє користувачам ділитися синтетичними, маніпульованими даними або даними, вирваними з контексту, які можуть ввести в оману користувачів платформи і завдати їм шкоди. Крім того, X може маркувати дописи, що містять оманливі матеріали, щоб допомогти людям зрозуміти їх достовірність і надати додатковий контекст, що включає в себе маркування ШІ-згенерованого контенту.

- TikTok вводить маркування на рівні своїх «Правил спільноти та безпеки» і може автоматично застосовувати маркування до контенту, який, на думку модератора, є ШІ-згенерованим. Окрім цього, платформа вводить правила й функції, що дозволяють користувачам також позначати використаний ними ШІ-згенерований контент.

- Meta запроваджує маркування ШІ-згенерованого контенту для Facebook, Instagram and Threads, що передбачає розробку й застосування новітніх стандартів маркування. Також на платформи Meta будуть додаватись функції, з якими і користувачі зможуть позначати використання ШІ-згенерованого контенту, і сама платформа буде маркувати такий контент.

- Youtube розробляє оновлення до своїх «Правил спільноти», у яких буде більш детально описано процедуру маркування ШІ-згенерованого контенту на цій платформі. Стандарти будуть вимагати від користувачів позначати, коли вони завантажують на платформу ШІ-згенерований або ШІ-модифікований контент. Надаватимуться й нові параметри, що дозволяють вказати, чи є контент реалістичним, чи ШІ-згенерованим.

Ігрові платформи теж запроваджують схожі правила. Так, Steam вводить нові правила для розробників, щоб вони маркували та детально описували використання ШІ-згенерованого контенту та ШІ-технологій в іграх, які вони завантажують на платформу.

Медіа. Маркування стає все більш поширеним і серед різних медіа. Наприклад, шведське видання Aftonbladet встановлює правила, що ШІ-згенерований контент має бути чітко промаркований. За їхніми внутрішніми правилами, зазвичай усі зображення опубліковані на їхніх ресурсах створені людьми, а якщо використовується ШІ-згенеровані зображення, це завжди чітко зазначено.

Аналогічно й CBC говорить про «відсутність сюрпризів» для своєї аудиторії, заявляючи, що вони будуть маркувати контент, створений ШІ. Окрім того, що це видання є членом-засновником проєкту Origin, який має на меті встановити стандарти походження та процес автентифікації контенту, CBC також підписалось на першу у своєму роді «Структуру для етичного та відповідального використання синтетичних медіа», що включає будь-які ШІ-згенеровані елементи медіа. Цю ініціативу також підтримали Adobe, BBC, Bumble, OpenAI, TikTok, WITNESS і стартапи синтетичних медіа Synthesia, D-ID і Respeecher.

Водночас деякі видавництва вирішують мінімізувати використання ШІ-згенерованого контенту, проте максимально його маркувати, коли це стається. Наприклад, BBC заявляє про пріоритезацію людських авторів та дуже поступове використання систем ШІ. Аналогічно й Wired вказує про те, що не буде використовувати ШІ-згенеровані зображення та текст, окрім виключних випадків, і завжди буде позначати це. Зі свого боку CNET зазначає, що не буде використовувати ШІ-згенерований контент у своїй діяльності, тільки потенційно використовувати ШІ-модифікований контент, позначаючи всі такі випадки. Associated Press також розробило та запровадило власні правила щодо безпеки, прозорості та маркування ШІ-згенерованого контенту, відповідно до яких видання не змінює жодних елементів фото-, відео- чи аудіоконтенту. Тому Associated Press не дозволяє використовувати ШІ-згенерований контент для будь-яких змін у своїх публікаціях, особливо якщо цей контент є підозрілим або доведено неправдивим.

Наочні приклади маркування контенту

Для успішного застосування маркування ШІ-згенерованого контенту законотворцем, розробниками, медіа тощо, потрібно розглянути детальніше, як маркування працює та у якому вигляді застосовується на різних рівнях. Окрім прикладу китайських Стандартів, де чітко розмежовуються явні візуальні логотипи та неявні внутрішні позначки в метаданих, існують й інші приклади практик маркування контенту.

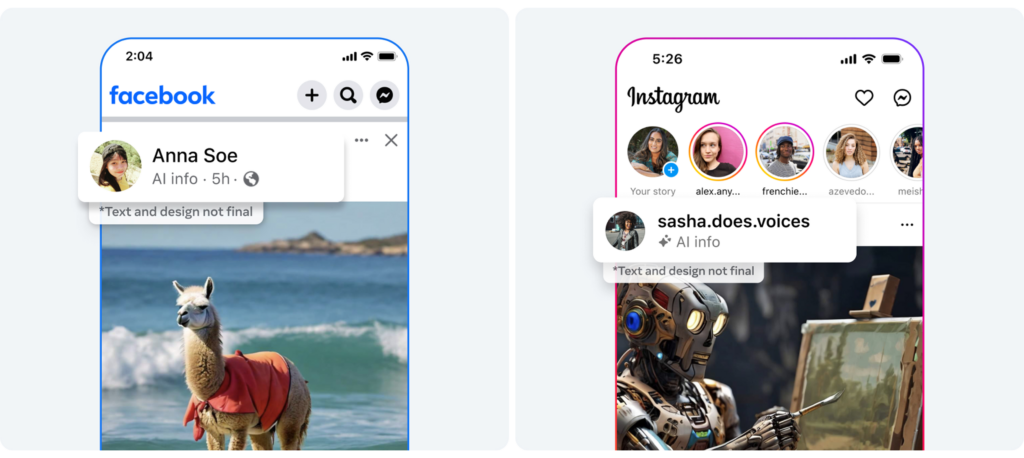

Meta схожим чином запроваджує видимі маркери і невидимі водяні знаки та метадані, вбудовані у файли відповідних фото або відео, як засоби маркування свого ШІ-згенерованого контенту. Важливо зазначити, що видимі маркери відображені усіма мовами та доступні для всіх користувачів. Ось візуальні приклади видимих маркерів від Meta на їхніх платформах Facebook (зліва) та Instagram (справа):

Фото: Meta

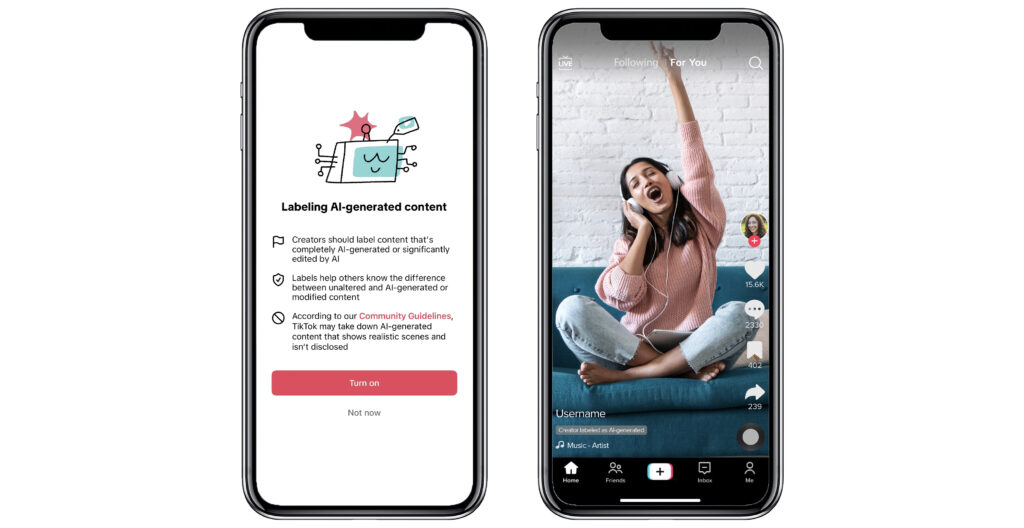

TikTok також запроваджує автоматичне маркування ШІ-згенерованого контенту крізь чіткі візуальні маркери на кожному відео, яке використовує такий контент. Ось приклад, як виглядатиме попередження про обов’язок користувачів маркувати контент (зліва) та сам маркер на відео (справа):

Фото: TikTok

Водночас OpenAI планує запровадити невидимі водяні знаки, аналогічно до Meta, для свого найпопулярнішого продукту ChatGPT. Невидимий водяний знак ChatGPT вставляє фрагмент коду у створений текст, включаючи знаки пунктуації. ШІ-згенерований текст слідує передбачуваним шаблонам слів, що полегшує вкладення водяних знаків для виявлення ШІ-згенерованого контенту. OpenAI також використовує й видимі маркери, наприклад, п’ять кольорових квадратів у нижньому правому кутку зображень, що генерує їхня система DALL-E. Ось приклади таких поміток на картинках, згенерованих цією системою ШІ:

Фото: Reddit, OpenAI

Рекомендації

Як казав Енді Воргол: «Важко визначити, де закінчуються справжні речі і починаються штучні». Для того, аби провести якомога більш чітку лінію між реальністю та ілюзією, ми рекомендуємо використовувати практики, описані вище у цій статті, на різних рівнях використання ШІ-згенерованого контенту:

- Для законотворців рекомендація полягає у якомога більш детальній та практичній розробці законодавства. Переважна більшість законотворчих ініціатив фокусується на впровадженні принципу маркування, але не дає детального пояснення або прикладів того, яким маркування має бути. Саме тому пропонуємо додатково розробляти підзаконні акти, які матимуть детальні технічні стандарти маркування з конкретним описом того, як маркування має виглядати. Отже, комбінація загальних принципів маркування із конкретними технічними стандартами, які описують як маркування має бути застосовано, — це найкращий шлях до ефективного запровадження маркування ШІ-згенерованого контенту.

- Для розробників систем ШІ рекомендація полягає у впровадженні маркування на всіх рівнях використання ШІ-згенерованого контенту. Окремо варто розглянути можливість впровадження автоматизованого маркування з використанням технологій розпізнавання ШІ-згенерованого контенту, таких як Sentinel, FakeCatcher або WeVerify. Впровадження автоматичного маркування на кшталт того, яке використовує TikTok, могло б надати додатковий шар захисту контенту у вигляді автоматизованого огляду та маркування.

- Для медіа рекомендація полягає в активному моніторингу діяльності розробників систем ШІ, послугами яких ті чи інші медіа користуються. Помірковане використання ШІ-згенерованого контенту, відповідно до Рекомендацій Міністерства цифрової трансформації, означає, що варто уникати застосування такого контенту при демонстрації реальних подій або осіб, а також завжди маркувати згенерований контент при використанні.

- Для громадський організацій та представників академічної спільноти рекомендація полягає в детальному дослідженні можливостей ширшого застосування невидимих водяних знаків та інших більш потужних засобів маркування. Враховуючи велику кількість засобів, що прибирають або замальовують видимі маркери на фото та відео, технології автоматичного або невидимого маркування є важливим наступним кроком у дослідженні експертів із ШІ-згенерованого контенту. Варто розвивати технології, що дозволяють більш ефективне маркування, яке перевіряється не тільки «на око», а й за допомогою метаданих файлів та технічного аналізу.

- Для користувачів генеративного ШІ рекомендації полягають у тому, аби додатково перевіряти відповідність систем ШІ та їх розробників стандартам прав людини та наявному законодавству й принципам відповідальної розробки систем ШІ. Компанії, що використовують ШІ-згенерований контент, можуть запитувати у постачальників таких послуг додаткове підтвердження відповідності всім необхідним стандартам. Пересічним користувачам систем ШІ слід перевіряти інформацію, яку їм надає така система. Також слід утриматись від публікацій ШІ-згенерованого контенту від власного імені без вказання, що він ШІ-згенерований, або відповідного маркування. Наостанок, всім користувачам ШІ-згенерованого контенту варто слідкувати за оновленням політик соціальних мереж та інших платформ щодо ШІ, де вони можуть використати такий контент, оскільки прогрес у цій сфері надзвичайно швидкий і буває важко передбачити всі правила, яким буде підкорятися ШІ-згенерований контент завтра.

Олександр Батхін для Лабораторії цифрової безпеки